Medizin

Wie können wir die medizinische Versorgung verbessern?

Der Erfolg medizinischer Behandlungen hängt von der individuellen Expertise der Kliniker ab. Mit Computer- und Roboterunterstützung in der medizinischen Praxis auf der Grundlage von Expertenwissen und Mensch-Maschine-Interaktion geht CeTI die wichtigsten Herausforderungen, Grenzen und laufenden Arbeiten für die Chirurgie der nächsten Generation an. Das Ziel von U1 ist die Entwicklung eines kontextbewussten, medizinischen Assistenten in Echtzeit mit Human-in-the-Loop. Durch eine internationale Initiative mit führenden Experten auf diesem Gebiet streben wir eine verbesserte medizinische Versorgung und medizinische Ausbildungsumgebungen an.

Chirurgische Ausbildung

Um eine qualitativ hochwertige Patientenversorgung zu gewährleisten, ist es von entscheidender Bedeutung, medizinisches Personal effektiv und effizient zu schulen. Dies gilt insbesondere für anspruchsvolle chirurgische Techniken wie die laparoskopische oder robotergestützte Chirurgie oder für kritische Szenarien wie die Wiederbelebung von Patient:innen. Die laparoskopische Chirurgie ist ein chirurgisches Verfahren zur Untersuchung des Bauchraums, bei dem eine kleine Kamera mit einem dünnen Schlauch durch einen kleinen Einschnitt in der Bauchhaut eingeführt wird. Sie bietet viele Vorteile, ist aber aufgrund der umständlichen Verwendung von Instrumenten und des Verlusts der Tiefenwahrnehmung schwierig zu erlernen und durchzuführen. Aus diesem Grund untersuchen wir, wie die konventionelle medizinische Ausbildung mit Hilfe moderner Technologie verbessert werden kann. Insbesondere verwenden wir eine Vielzahl von Sensormodalitäten, um die Aktivitäten des auszubildenden Arztes oder Ärztin wahrzunehmen, und neuartige maschinelle Lernalgorithmen, um die gesammelten Sensordaten zu analysieren. Unser Schwerpunkt liegt auf der Entwicklung intelligenter Algorithmen, die dem angehenden medizinischen Personal automatisch konstruktives Feedback und eine objektive Bewertung seiner Fähigkeiten geben.

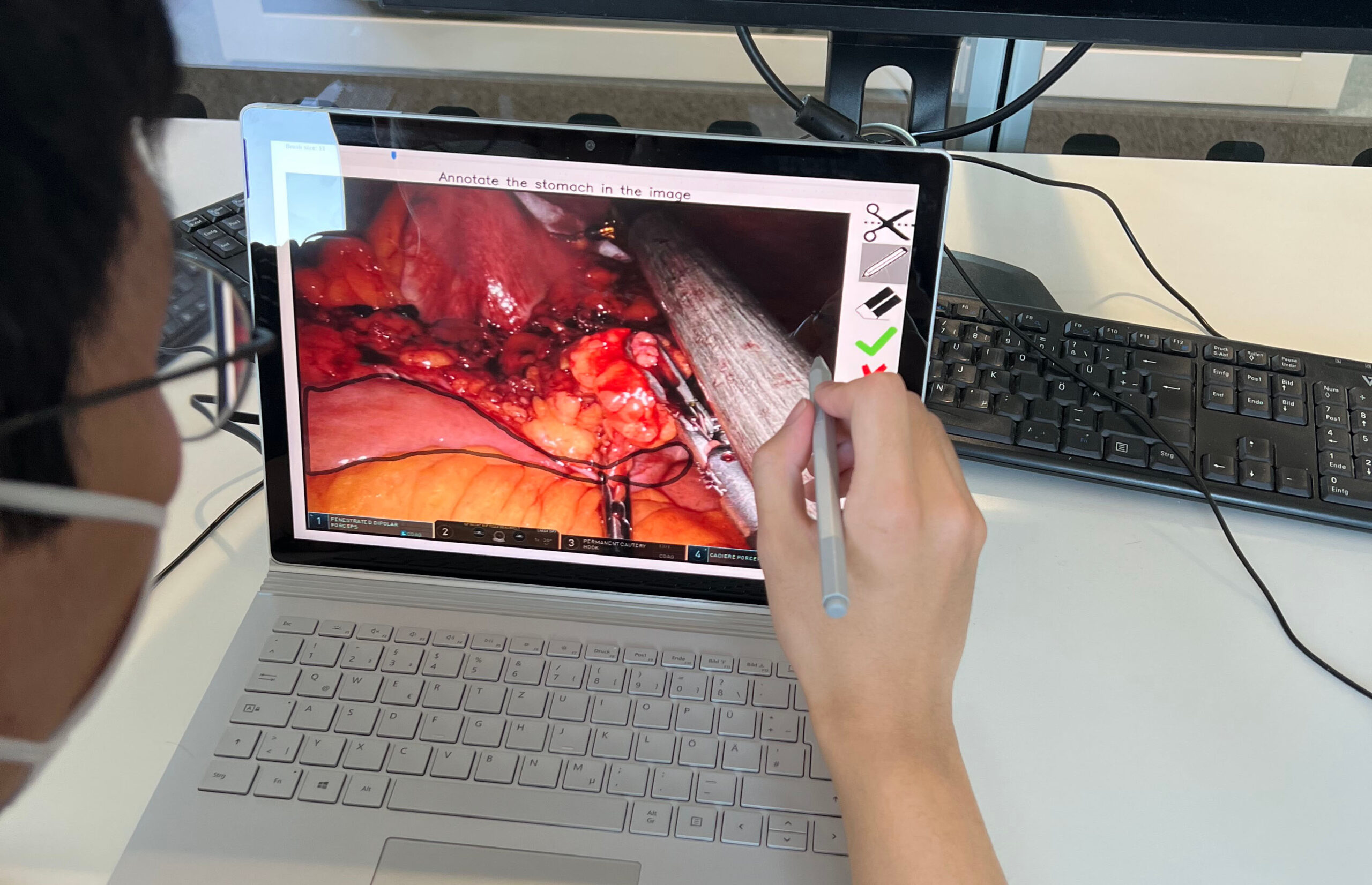

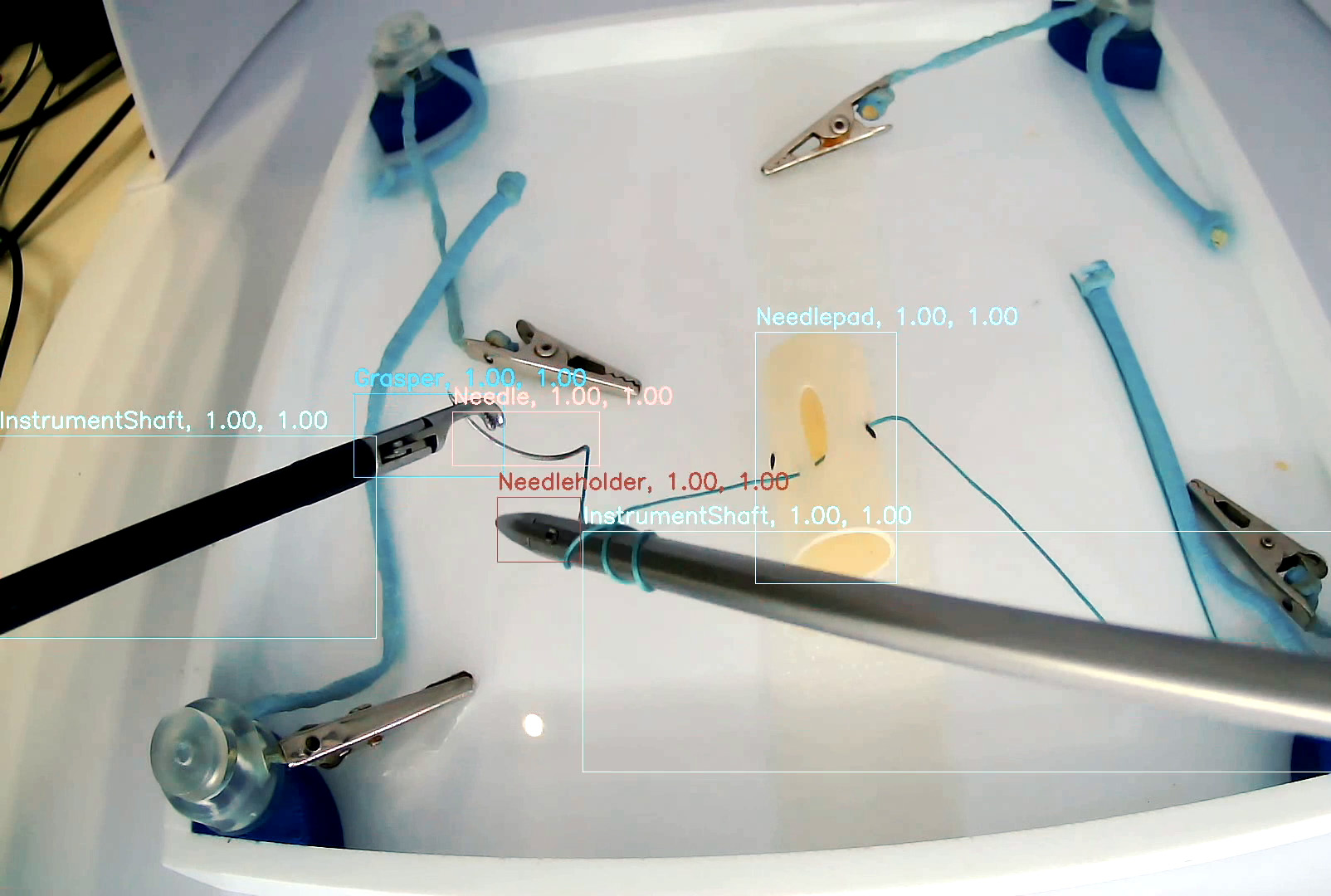

KI-unterstützte chirurgische Ausbildung

Das Training für die Schlüssellochchirurgie (minimalinvasive Chirurgie wie die Laparoskopie) ist komplex und der Lernerfolg ist noch nicht objektiv messbar. Zur Optimierung des chirurgischen Trainings wurde bereits ein Prototyp gebaut, der in kleinen Anwenderstudien vielversprechende Ergebnisse geliefert hat. Der Prototyp nutzt eine schnelle, auf maschinellem Lernen basierende Szenenanalyse, die den Lernfortschritt analysiert und mit Experten vergleicht. Dazu wurde ein großer Datensatz gesammelt, der dazu verwendet wurde, haptisches Feedback über das Instrument zu generieren, das auf Kräften und der Sichtbarkeit des Instruments basiert.

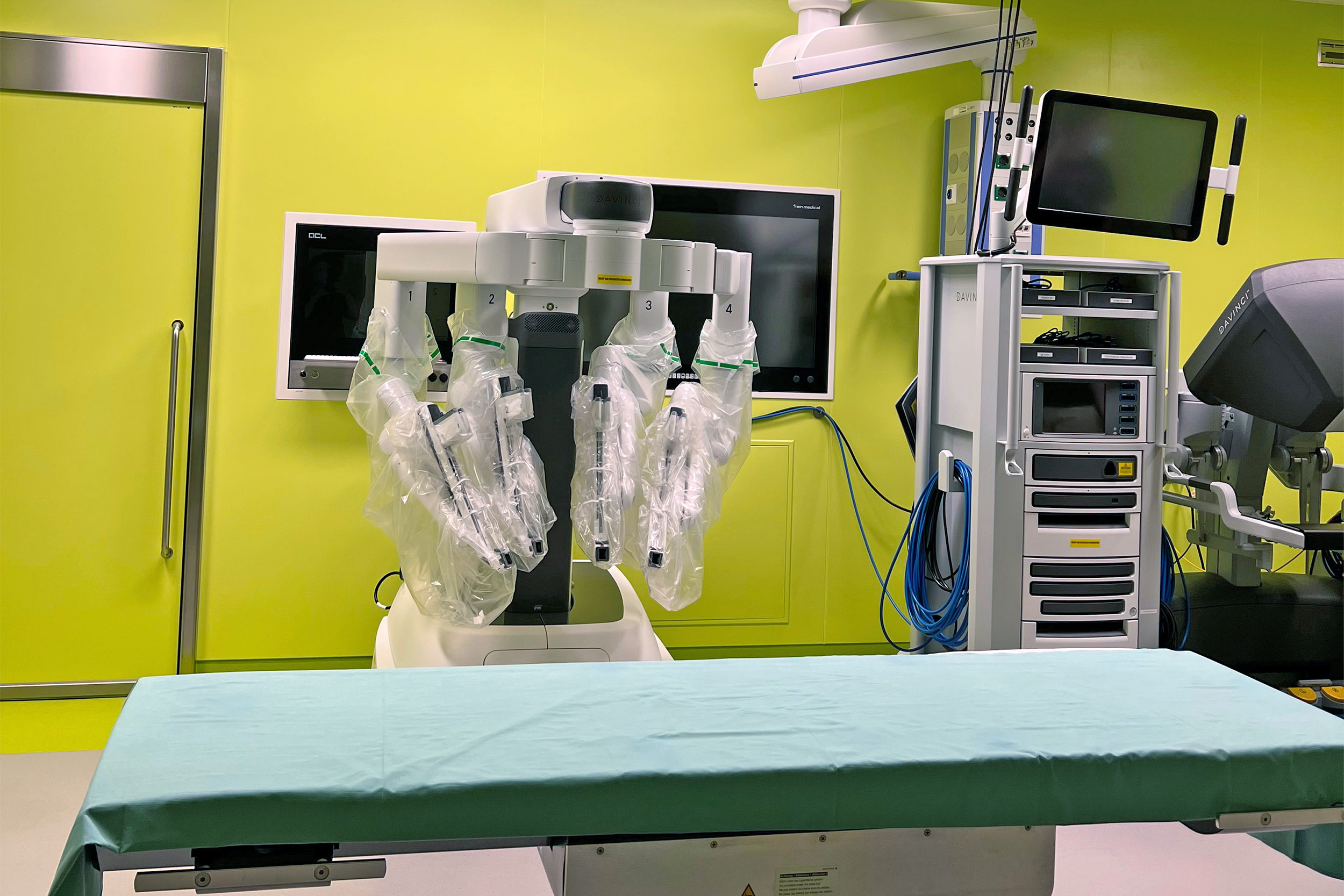

Robotergestützte Chirurgie

Im Mittelpunkt dieses Projekts steht die Echtzeitanwendung medizinischer Fähigkeiten für die Computer- und Roboterunterstützung. Ziel ist die Entwicklung von Echtzeitmethoden zur Analyse von Sensordaten im Operationssaal, um dem Operationsteam kontextbezogene Unterstützung zu bieten. Die robotergestützte Chirurgie bietet dem Chirurgen oder der Chirurgin viele Vorteile, wie z. B. Stereosicht, verbesserte Instrumentenkontrolle und bessere ergonomische Einstellungen. Die Forschung im Bereich der robotergestützten Chirurgie konzentriert sich auf: eine Testumgebung für die Fernunterstützung in der laparoskopischen Chirurgie; künftige Netzwerktechnologien zur Steuerung von Operationsrobotern über große Entfernungen und intermittierende Verbindungen; neuartige Methoden für die autonome Kameranavigation; Integration innovativer Geräte und Sensoren (Datenhandschuh, VR-Headsets, Kraftsensoren) in den chirurgischen Arbeitsablauf. Dies erfordert Echtzeitsteuerung und Kommunikationsnetze mit geringer Latenz, Online-Analyse und wissensbasierte Interpretation von Sensordaten mit Methoden des maschinellen Lernens.

EndoMersion

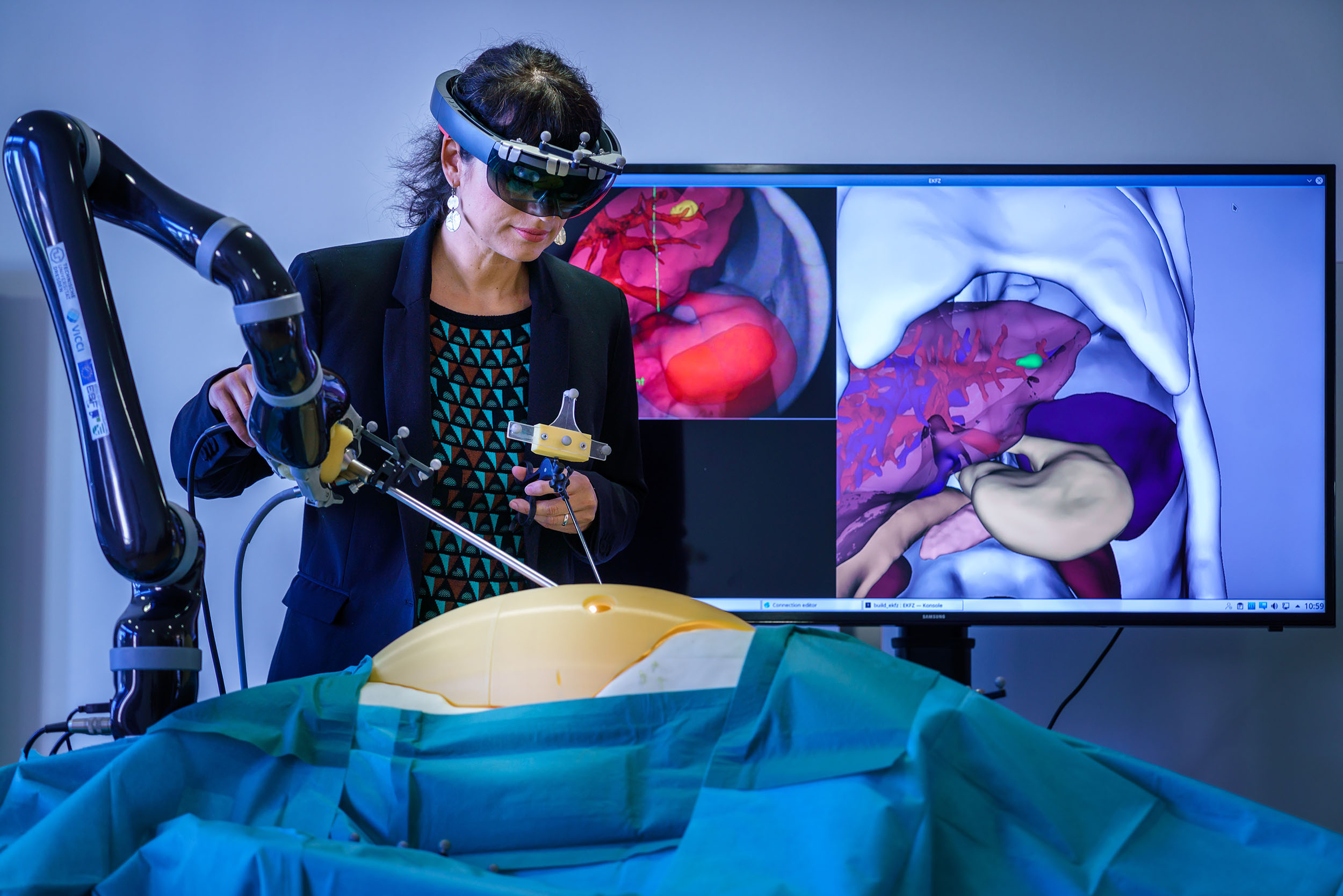

Der Demonstrator EndoMersion ist eine immersive robotergestützte Laparoskopführung mit 3D-Wahrnehmung. Ziel ist es, eine computergestützte Kameraführung während der Schlüssellochchirurgie unter Verwendung von Patienten- und Sensordaten zu ermöglichen. Die Navigation basiert auf Augmented Reality und Künstlicher Intelligenz. Wir akquirieren/ generieren/ annotieren große Datensätze realer chirurgischer Videos mit der chirurgischen Abteilung VTG, die von einem neuronalen Netz verarbeitet werden, um realistische simulierte Umgebungen zu schaffen, die z.B. optimale Schnittlinien zur Schonung von Nerven zeigen. Die Methoden werden entwickelt, um die Lücke zwischen Robotik, Sensoren und Datenwissenschaft in der Chirurgie zu schließen.

CoBot

Das Assistenzsystem CoBot soll bei Tumoroperationen im Enddarm eingesetzt werden. Das Gerät entlastet den/die Chirurgen/Chirurgin vom direkten Halten und Bewegen von Instrumenten und übersetzt größere Handbewegungen, die der Operierende über zwei joystickähnliche Griffe ausführt, in winzige, zitterfreie Schnitte. Da Chirurg:innen auf visuelle Informationen angewiesen sind, werden zum richtigen Zeitpunkt Kamerabilder des Laparoskops mit zusätzlichen Informationen eingeblendet, etwa zur Lage wichtiger Nerven. Die Entscheidung trifft der Chirurg oder die Chirurgin jedoch zu jedem Zeitpunkt selbst. Das System unterstützt lediglich, ähnlich wie ein Navigationssystem im Auto.

Kooperative Forschungsprojekte

Für den Operationssaal von morgen werden verschiedene Technologien benötigt, die in unterschiedlichen Forschungsprojekten getestet werden, die sich gegenseitig ergänzen und aufeinander aufbauen.

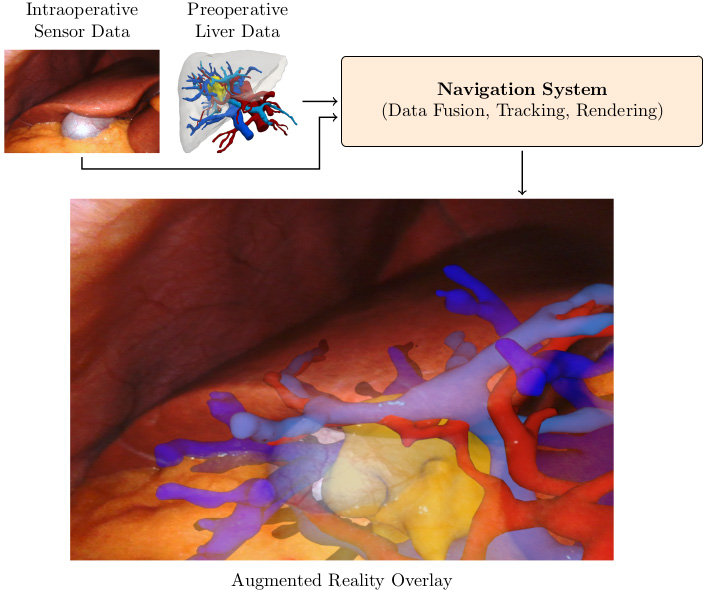

Navigation

Der Zweck der intraoperativen Navigation besteht darin, Informationen über verborgene Risiko- und Zielstrukturen auf der Grundlage der präoperativen Planungsdaten des Patienten bereitzustellen. Die Visualisierung kann über Augmented Reality (AR) erfolgen, indem die Informationen entweder direkt in die endoskopische Ansicht eingeblendet werden oder eine Brille verwendet wird. Bei der Weichgewebenavigation wird dieser Prozess durch die Verformung des Organs, die durch die auf die Organe einwirkenden Kräfte, das Schneiden des Gewebes, die verschiedenen Patientenhaltungen und die Atmung des Behandelten verursacht wird, erheblich erschwert. Die Schätzung der organinternen Deformation und der Bewegung von Risiko-/Zielstrukturen aus intraoperativen Sensordaten (z. B. chirurgischen Videoströmen) und präoperativen Daten in Echtzeit ist ein offenes Forschungsthema. Unser Team setzt für viele dieser Aufgaben neuartige Methoden des maschinellen Lernens ein.

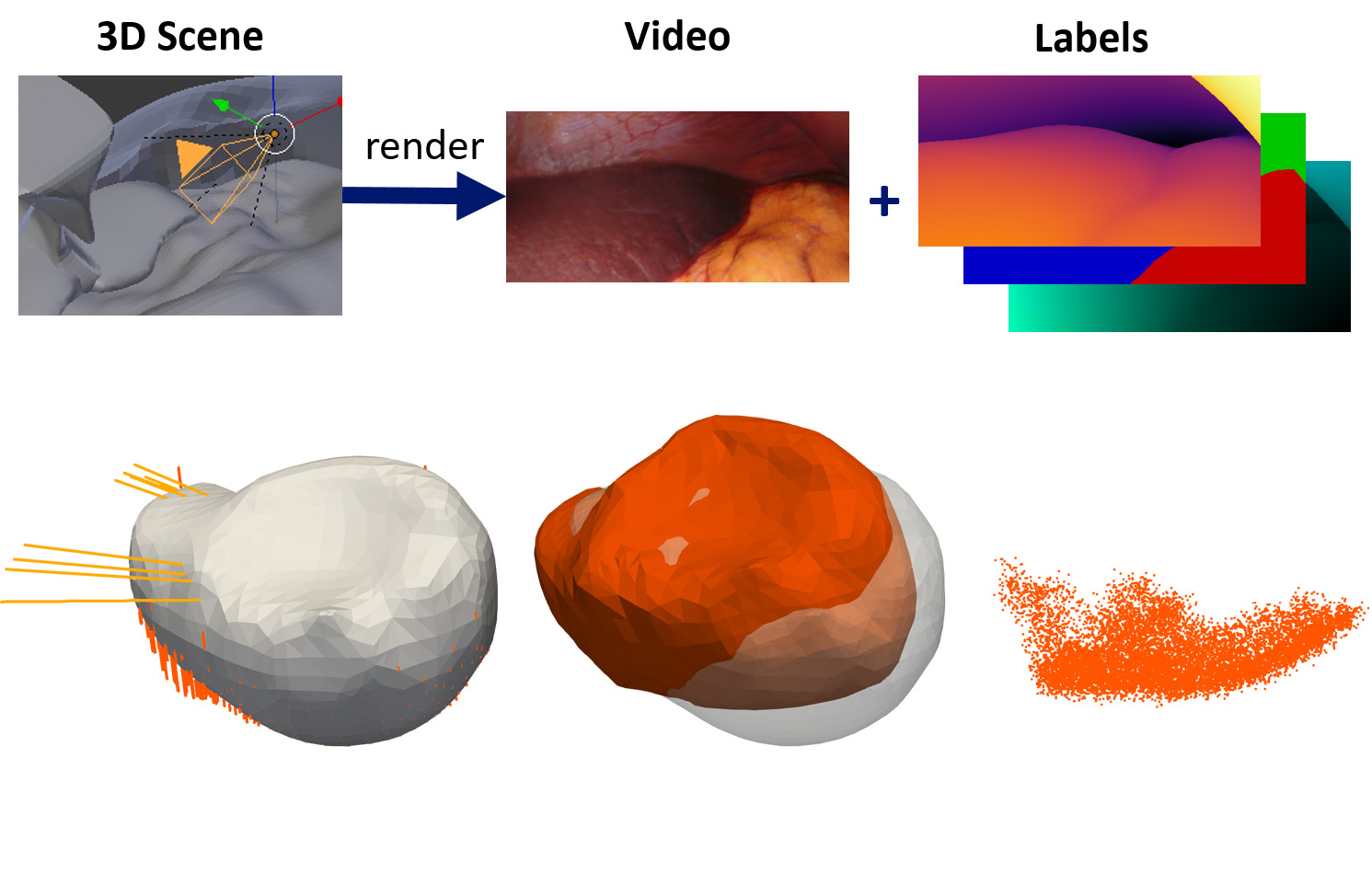

Simulation

Im chirurgischen Bereich gilt die Beschaffung von Daten mit Grundwahrheit für Computer-Vision-Aufgaben fast immer als ein großer Engpass. Dies gilt insbesondere für Grundwahrheiten, die zusätzliche Sensoren (z. B. Tiefe, Kamerapositionen, 3D-Informationen) oder feinkörnige Annotationen (z. B. semantische Segmentierung) erfordern würden. Zu diesem Zweck sollen photorealistische Bild- und Videodaten aus einfachen chirurgischen Simulationen (z.B. laparoskopische 3D-Szenen) gerendert werden.

Es gibt so gut wie keine öffentlich zugänglichen Datensätze, die die Leber einer einzelnen Person in mehreren deformierten Zuständen zeigen. Um unsere maschinellen Lernalgorithmen für die Navigation voranzutreiben, entwickeln wir Simulationspipelines zur Erzeugung synthetischer Verformungen von realen und nicht-realen Organen. Wir bauen auf physikalischen biomechanischen Modellen auf, um eine riesige Menge an semi-realistischen Daten zu erzeugen, die dann zum Trainieren schneller und leistungsstarker neuronaler Netze verwendet werden.